python 에서 resize 이벤트 만들기

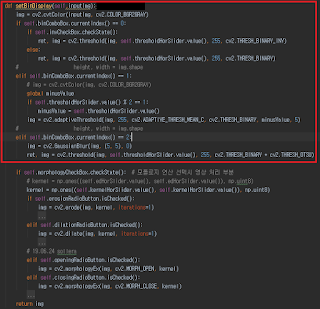

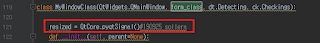

➤ pyqt 로 만든 임의의 창이 최대화를 하면 그에 따라 widget의 크기도 변해야 하나 변하지 않아 말썽이던 적이 있다. ➤ 최대화 버튼을 누르거나 임의로 창의 크기를 조절하면 이벤트가 발생하고 그 이벤트를 신호로 resize하는 함수를 만들어 보았다. ➤ 우선 Main에 신호를 선언하고 그 signal을 임의로 만들 slot과 연결하였다. <신호 선언> <선언한 신호와 함수 연결> <resize 이벤트가 발생할 떄 실행할 함수> ➤ 확인시 잘 동작하는 것을 확인 ➤ https://stackoverflow.com/questions/43126721/pyqt-detect-resizing-in-widget-window-resized-signal 참고하였음